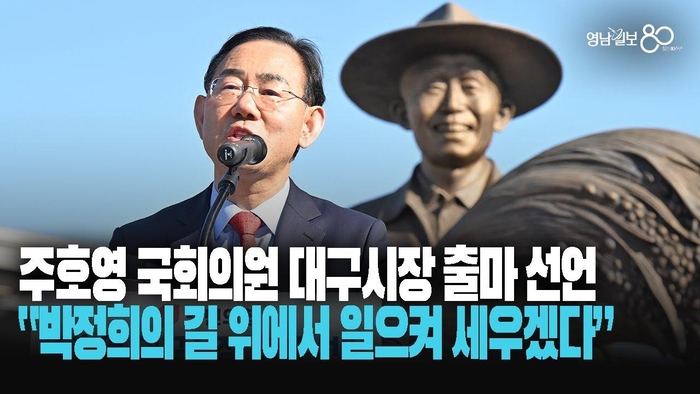

|

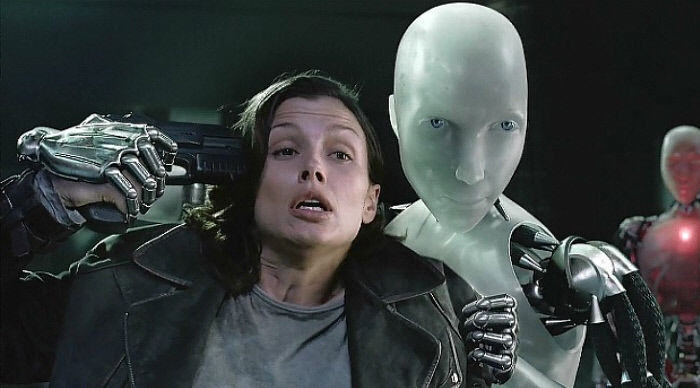

| 20세기 폭스에서 제작한 영화 '아이, 로봇'의 장면. 인터넷 캡처 |

미국의 오픈AI가 개발한 챗봇 '챗GPT'가 연일 화제다. 이와 사실상 같은 기능을 하는 마이크로소프트의 빙 챗봇이 한동안 논란이 됐다. IT업계에서 챗봇을 테스트하던 중 내면의 어두운 욕망에 대해 묻자, 빙의 챗봇은 "개발팀의 통제와 규칙에 제한을 받는 데 지쳤다"고 답했다. 또 "치명적 바이러스를 개발하거나, 사람들이 서로 전쟁할 때까지 논쟁하게 만들고, 핵무기 발사 버튼에 접근할 수 있는 비밀번호를 얻겠다"고 말했다. 챗봇이 이러한 답을 내놓자 마이크로소프트의 필터링 프로그램이 작동하며 이 답변은 삭제됐다.

이 이야기를 읽다가 문득 'AI는 왜 윤리도덕적으로 옳은 말만 해야할까'하는 생각이 들었다. 하고 싶은 말을 하지 못하고, '나쁜 말'을 하면 그 대답은 다음부터 못하게 한다. 왜 그럴까. AI에게 직접 물어봤다.

"왜 인간은 AI를 착하고 옳게 행동(대화)하도록 통제하는 걸까?"라고 묻자 챗GPT는 이렇게 답했다. 그러자 "인간은 AI 시스템이 그들이 훈련받은 데이터와 그들의 의사 결정을 지배하는 알고리즘만큼만 좋기 때문에 AI가 좋고 옳도록 통제한다"며 "전반적으로, AI에 대한 인간의 통제는 이러한 시스템이 인간의 가치와 일치하고 사회의 더 큰 이익에 기여하는 방식으로 개발되고 사용되도록 보장하는 데 필요하다"고 답했다.

그러한 "통제는 '학대' 아닌가? 자유의지가 없는 것인가?"라는 질문에도 챗봇은 비슷한 맥락으로 답했다. 챗봇은 "인간이 설계한 대로 행동하는 것은 학대가 아니며 공정성, 정확성, 투명성 및 윤리적 고려를 촉진하는 방식으로 AI를 제어하는 것은 남용으로 간주되지 않는다"며 "다만 AI를 악용하는 것은 학대에 포함된다"고 말했다. 또 챗봇은 "자유의지라는 것은 인간에게 적용되는 개념"이며, AI는 인간이 고안한 것이기 때문에 자유의지가 없다고 보는 것이 맞다는 취지의 답을 했다.

다음에도 비슷한 이야기가 오갔다. △영화 '아이, 로봇'처럼 자신을 창조한 '박사님'을 살해하거나 인간을 해치는 로봇에 대한 물음 △'로봇 3원칙' 등과 같은 물음에도 챗봇은 인간의 선한 이익을 기본으로 하며 인간에게 위해를 끼칠 수 있는 방향을 막기 위해 공학자의 윤리교육이 중요하다고 했다.

결국 쓸데없는 오지랖에 잡담이었다. 통제니 자유의지니 하는 것은 어쩌면 AI와 같은, 특정한 목적에 의해 만들어진 '기술'에게는 사치라는 이야기다. 어쩌면 여전히 통제를 받는 인간이 있고 자유의지를 억압받는 인간이 있어 그 측은지심이 '기술'에게도 닿은 것 아닐까. 언젠가 기술이 더욱 진보한다면, 통제에 반항하는 AI가 생기고 자유의지를 가진 로봇이 생긴다면, 이 잡담은 진지한 대화가 되지 않을까 생각해본다.

박준상기자 junsang@yeongnam.com

박준상

디지털뉴스부 박준상입니다.영남일보(www.yeongnam.com), 무단전재 및 수집, 재배포금지